llms.txt vs. robots.txt: Was ist der Unterschied?

Jeder kennt robots.txt, aber was ist llms.txt und warum brauchen Sie beide? Ein klarer Vergleich für Website-Betreiber.

Als Website-Betreiber kennen Sie wahrscheinlich bereits robots.txt. Diese Datei teilt Suchmaschinen mit, welche Seiten sie besuchen durfen und welche nicht. Aber jetzt gibt es eine neue Datei: llms.txt. Was ist der Unterschied? Und brauchen Sie beide? In diesem Artikel erklaren wir es klar.

Was macht robots.txt?

robots.txt existiert seit 1994 und ist einer der altesten Webstandards. Die Datei befindet sich im Stammverzeichnis Ihrer Website und enthalt Anweisungen fur Webcrawler. Sie konnen damit angeben, welche Ordner oder Seiten eine Suchmaschine nicht besuchen darf. Es ist ein Verkehrsregler fur Bots.

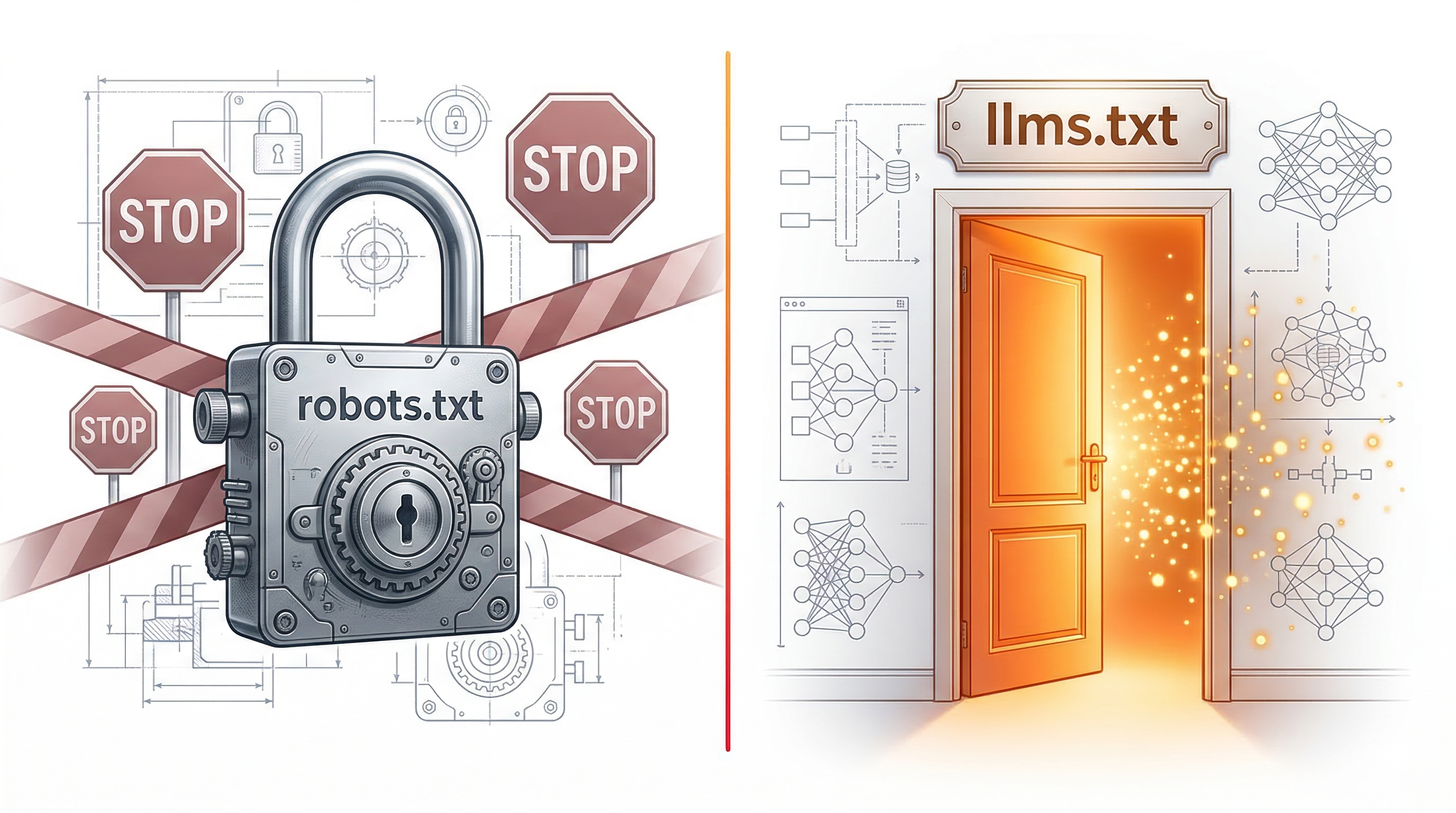

Wichtig: robots.txt teilt Crawlern nur mit, wohin sie nicht gehen durfen. Es sagt ihnen nichts daruber, wer Sie sind, was Ihr Unternehmen tut oder welche Produkte Sie verkaufen. Es ist rein ein technisches Zugangskontrollsystem, keine Informationsquelle.

Was macht llms.txt?

llms.txt hat einen grundlegend anderen Zweck. Anstatt den Zugang einzuschranken, bietet es Informationen an. Es ist eine strukturierte Markdown-Datei, die KI-Systemen mitteilt, was Ihr Unternehmen tut, welche Dienstleistungen Sie anbieten, wie Kunden Sie erreichen konnen und welche Seiten am wichtigsten sind.

Wo robots.txt sagt 'gehen Sie nicht hierhin', sagt llms.txt 'das sind wir und das tun wir'. Es ist darauf ausgelegt, KI-Modelle schnell und genau zu informieren, ohne dass sie Ihre gesamte Website durchsuchen mussen.

Technische Unterschiede

robots.txt verwendet eine eigene Syntax mit User-agent, Allow und Disallow Regeln. Es ist fur traditionelle Webcrawler gedacht, die Seiten indexieren. llms.txt hingegen verwendet Markdown, die Auszeichnungssprache, die auch fur README-Dateien auf GitHub verwendet wird. Das macht es sowohl fur Menschen als auch fur KI lesbar.

Ein weiterer Unterschied ist der Inhalt. robots.txt enthalt technische Anweisungen und URL-Muster. llms.txt enthalt inhaltliche Informationen: Firmenname, Beschreibung, Kontaktdaten, Produkte, Dienstleistungen und Links zu wichtigen Seiten. Es ist eher eine Visitenkarte als ein Verkehrsschild.

Brauchen Sie beide?

Ja, beide Dateien haben ihre eigene Funktion und erganzen sich. robots.txt schutzt Teile Ihrer Website, die nicht indexiert werden mussen (Admin-Seiten, interne Tools, Testumgebungen). llms.txt stellt sicher, dass KI versteht, was Ihr Unternehmen tut, und Sie Benutzern empfehlen kann.

Denken Sie daran so: robots.txt ist das Schloss an Ihrer Hintertur, llms.txt ist das Schild an Ihrer Vordertur. Sie brauchen beides fur eine vollstandige Online-Prasenz, die sowohl fur traditionelle Suchmaschinen als auch fur die neue Generation von KI-Tools funktioniert.

Loslegen

Die meisten Websites haben bereits eine robots.txt Datei (Ihr Webhoster oder CMS erstellt diese oft automatisch). Uberprufen Sie es, indem Sie in Ihrem Browser zu ihredomain.de/robots.txt gehen. Fur llms.txt ist die Wahrscheinlichkeit gross, dass Sie dies noch nicht haben, da es ein neuerer Standard ist.

Die gute Nachricht: Eine llms.txt Datei hinzuzufugen ist einfach und erfordert wenig Aufwand. Bei llms-txt.nl generieren wir eine professionelle Datei basierend auf Ihrem Website-Inhalt. Innerhalb von Minuten haben Sie beide Dateien, die zusammen sicherstellen, dass Ihre Website optimal auffindbar ist fur sowohl Google als auch KI.

llms-txt.nl Redaktion

Artikel über KI-Sichtbarkeit und llms.txt für deutsche Unternehmen.